SINGAPURA – Start-up lokal BasisAI sedang mempersiapkan kolaborasi regional dengan kecerdasan buatan yang “bertanggung jawab” berdasarkan kolaborasi dengan Facebook dan Infocomm Media Development Authority (IMDA).

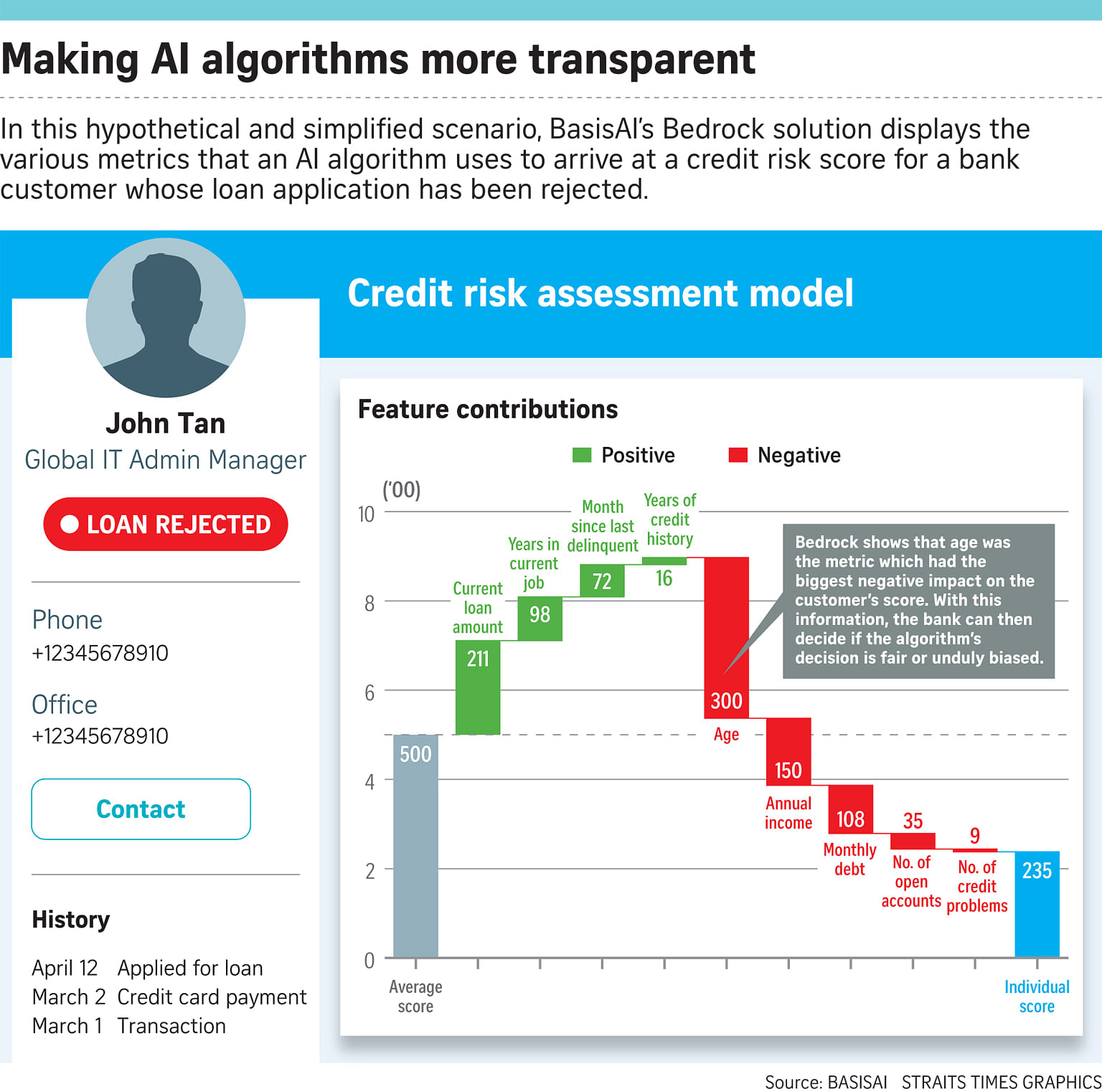

Solusi pembelajaran mesin Bedrock BasisAI berfungsi sebagai auditor dunia maya untuk algoritme AI dengan membuat proses pengambilan keputusan mereka lebih transparan dan membantu ilmuwan data mengidentifikasi kapan algoritme mungkin bias secara tidak adil.

Perusahaan tersebut baru-baru ini bermitra dengan Facebook dan IMDA untuk membantu 12 lebih banyak startup di wilayah Asia-Pasifik prototipe algoritma AI yang etis dan efisien dalam program enam bulan yang berakhir bulan lalu.

Program ini adalah bagian dari inisiatif Open Loop Facebook, yang bertujuan untuk bekerja dengan pembuat kebijakan dan perusahaan teknologi di seluruh dunia untuk mengembangkan kerangka kerja regulasi untuk teknologi baru seperti AI.

BasisAI telah menjalin kemitraan dengan salah satu dari 12 perusahaan rintisan – Nodeflux start-up visi komputer Indonesia – untuk lebih mengembangkan kemampuan menjelaskan algoritma pengenalan wajah dan pengenalan objek yang terakhir.

“Kami benar-benar ingin bermitra dengan perusahaan layanan keuangan, perawatan kesehatan, dan transportasi yang ambisius di wilayah ini,” kata Liu Fengyuan, CEO BasisAI.

“Kami melihat kesadaran sosial yang lebih besar dari AI yang bertanggung jawab, dan saya pikir lebih banyak perusahaan sekarang khawatir tentang risiko reputasi dari mengadopsi AI, yang merupakan kotak hitam.”

Misalnya, pada Agustus tahun lalu, Kantor Pusat Inggris meninggalkan algoritme AI kontroversial yang digunakan untuk memproses aplikasi visa imigran setelah para aktivis mengklasifikasikan algoritme tersebut sebagai “rasis” karena diduga lebih memilih kebangsaan tertentu daripada yang lain.

Kantor Pusat tidak memberikan penjelasan tentang bagaimana alat AI-nya bekerja pada saat itu, dan algoritme tersebut dibatalkan seminggu sebelum peninjauan ruang sidang atas pengambilan keputusannya.

AI yang bertanggung jawab juga menjadi pusat dari perselisihan yang sedang berlangsung antara Google dan karyawannya yang menyebabkan kepergian dua peneliti AI terkemuka.

“Contoh paling sederhana dari AI yang bertanggung jawab adalah tab (Tab) Netflix ‘Because You Were Watching’ yang memberi tahu Anda karena Anda menonton Wonder Woman, jadi kami merekomendasikan acara lain ini,” kata Liu.

“Ini menghilangkan beberapa faktor creep ketika Anda diberi tahu (riwayat menonton Anda) bahwa ini adalah salah satu alasan utama Anda diperlihatkan rekomendasi ini, bukan karena sesuatu yang lain sedang dikejar.”

Bedrock diperkenalkan pada Juni tahun lalu, kurang dari dua tahun setelah Liu mendirikan BasisAI dengan saudara kembar Linus dan Silvanus Lee pada 2018.

Tn. Liu sebelumnya adalah direktur Departemen Ilmu Data dan AI di Badan Teknologi Pemerintah, sementara dua rekan pendiri yang berbasis di AS bertugas dalam peran ilmu data di Twitter, Uber, dan Dropbox.

Perusahaan saat ini bekerja sama dengan DBS Bank, Accenture dan PwC, antara lain.

Liu mempertanyakan anggapan bahwa mengembangkan AI yang bertanggung jawab adalah langkah ekstra yang membutuhkan upaya ekstra.

“Jika Anda tidak melakukan apa-apa, Anda harus melakukan audit untuk menggali email dan semua itu,” katanya.

“Tapi jika Anda memeriksa kode saat Anda bekerja di (Bedrock), itu melakukan logging dan pemantauan untuk Anda.

“Ini tentang memulai dengan fondasi yang tepat di mana tata kelola bukanlah renungan.”

Transparansi lebih banyak melalui ‘kotak hitam’ AI

Algoritme kecerdasan buatan (AI) dirancang untuk melakukan tugasnya di latar belakang, tanpa disadari, melakukan tugas yang membosankan, dan membuat keputusan sederhana atas nama perancang manusianya.

Dengan percepatan dan pengembangan lebih lanjut dari AI, peninjauan proses pengambilan keputusan yang tidak jelas dari algoritme semacam itu telah dipercepat, terutama ketika keputusan dianggap bias atau tidak adil.

“Seringkali (perusahaan) tidak mengejar inisiatif AI karena kekhawatiran tentang transparansi dan penjelasan,” kata Liu Fengyuan, CEO BasisAI. “Mereka berkata, ‘Hei, Anda memberi saya kotak hitam yang tidak saya mengerti dan saya tidak akan menggunakannya.'”

Di sinilah solusi Bedrock BasisAI berperan, mengubah kotak hitam AI menjadi kotak kaca di mana cara kerja bagian dalam dari algoritme dapat diidentifikasi dan dijelaskan dengan jelas.

Seorang ilmuwan data menjalankan algoritmanya melalui perangkat lunak Bedrock saat melakukan pengkodean.

Bedrock kemudian menandai semua metrik yang digunakan oleh algoritme AI untuk membuat keputusan. Ini dapat berkisar dari usia dan jenis kelamin hingga status keuangan dan alergi kesehatan hingga bobot metrik individu.

Misalnya, algoritme AI bank dapat memberikan peringkat risiko tertentu kepada pelanggan yang mengajukan pinjaman.

Dengan Bedrock, tim teknis bank dapat menampilkan metrik yang menentukan skor.

Usia klien mungkin telah meningkatkan skor sementara jumlah masalah kredit sebelumnya mungkin telah menurunkannya. Tim bank kemudian dapat mengidentifikasi dan memperbaiki bias yang tidak diinginkan dalam algoritme.

Liu mengatakan wawasan Bedrock ditujukan untuk para pembuat keputusan di perusahaan dengan keahlian teknis seperti kepala ilmuwan data atau kepala petugas teknologi.

“Namun seiring waktu, kami ingin membuat laporan ini lebih mudah diakses oleh orang awam karena keputusan dibuat tidak hanya oleh data scientist senior tetapi juga oleh orang yang berisiko,” tambahnya.

You may also like

-

Aturan matematika ditemukan di balik distribusi neuron di otak kita

-

Para ilmuwan menemukan penjelasan untuk lubang gravitasi raksasa di Samudra Hindia

-

Peta baru yang akurat dari semua materi di alam semesta dirilis

-

Para ilmuwan mengatakan sepasang bintang yang sangat langka berperilaku sangat ‘aneh’

-

Lima Angsa Tewas Setelah Terbang Ke Saluran Listrik Hinkley | Berita Inggris